معرفی کارت گرافیک های NVIDIA رده بندی و نسل های آنها؛ پادکست

کارت گرافیک های NVIDIA در سیستمهای حرفهای استفاده میشوند و به طور کلی سه دسته هستند: NVIDIA Quadro و NVIDIA GeForce و Nvidia Tesla. کاربرد انویدیا در گیمینگ، انیمیشن، شبیه سازی، طراحیهای 3D و صنعتی است. از بین این سه دسته، انویدیا تسلا مخصوص سرورها و دیتاسنترهاست و در ورک استیشن ها هم به کار میروند. یکی از سوالاتی که هنگام کانفیگ پی سی و ورک استیشن با آن روبهرو میشویم، این است که کدام کارت گرافیک انویدیا بهتر است؟ جی فورس یا کوآدرو؟ هر یک برای چه کاربردی مناسب است؟ در ادامه به مقایسه کارت گرافیک های nvidia و بررسی نقاط قوت و ضعف هر یک از این کارت گرافیک ها میپردازیم. در اینصورت اگر قصد خرید لپ تاپ یا کامپیوتر را دارید میتوانید انتخابی هوشمندانهتر بر اساس نیاز و بودجه خود داشته باشند؛ پس در ادامه با ما همراه باشید.

فهرست محتوا

پادکست با موضوع تفاوت کارت های گرافیک کوآدرو و جی فورس

یکی از دغدغههای ما هنگام خرید سخت افزارها این است که از بین این همه تنوع در مدل، کدام یک را انتخاب کنم و کدام یک برای من مناسبتر است؟پادکستی که با عنوان تفاوت کارت های گرافیک کوآدرو و جی فورس در ادامه ارایه میدهیم حاوی نکاتی است که در انتخاب و خرید کارت گرافیک مناسب به شما هنگام بستن سیستمهای PC و Workstation، کمک خواهد کرد. نکاتی که بتوانید مدل مناسب را بر اساس نیازهای خود، انتخاب کنید.

در این پادکست به موارد زیر پرداخته میشود:

- بررسی انواع کارت گرافیک NVIDIA (انویدیا)

- بررسی کارت گرافیک کوآدرو (Quadro GPU)

- بررسی کارت گرافیک جی فورس (Geforce GPU)

- بررسی کارت گرافیک تسلا (Tesla GPU)

- مقایسه کارت گرافیک جی فورس و کوآدرو

- هر نوع کارت گرافیک مناسب چه کسانی است؟

در این پادکست به همراه بخش تخصصی، اخبار تکنولوژی و مناسبتهای ماه را هم میتوانید پیگیری کنید؛ این نسخه پادکست 31 مگابایت حجم و 34 دقیقه زمان دارد. زمانبندی این پادکست در جدول زیر آمده است:

| محدوده زمانی | موضوع بحث پادکست |

|---|---|

| دقیقه 10 تا 15 | بررسی انواع کارت گرافیک NVIDIA (انویدیا) |

| دقیقه 15 تا 20 | بررسی کارت گرافیک کوآدرو (Quadro GPU) |

| دقیقه 15 تا 20 | بررسی کارت گرافیک جی فورس (Geforce GPU) |

| دقیقه 15 تا 20 | مقایسه کارت گرافیک جی فورس و کوآدرو |

تاریخچه انویدیا

NVIDIA شرکتی آمریکایی است که در سال ۱۹۹۳ تأسیس شد و در تولید تکنولوژیهای کارتهای ویدئویی، گرافیکی، ورک استیشن، رایانههای شخصی، دستگاههای پورتابل در سرتاسر جهان فعال است. NVIDIA یکی از فروشندههای اصلی کارت و پردازندههای گرافیکی (GPU) و رقیب AMD است.

تمام NVIDIA GPU ها از GPGPU یا General Purpose GPU پشتیبانی میکنند اما تمام انواع کارت گرافیک NVIDIA، کارایی و ویژگیهای یکسانی ندارند. برخی ویژگیها هم فقط در کارت گرافیکهای حرفهای Tesla و Quadro وجود دارد. در نسل های کارت گرافیک nvidia از معماریهای مختلفی استفاده شده که جدیدترین آنها معماری تورینگ است. تورینگ و کودا و پاسکال همواره بهترین تکنولوژیهایی است که انویدیا به بازار عرضه کرده است.

مطالب مرتبط: مقایسه کارت گرافیک AMD و NVIDIA

انواع کارت گرافیک nvidia

سری های کارت گرافیک nvidia به طور کلی به سه دسته تقسیم میشوند:

- Quadro

- Geforce

- Tesla

1- کارت گرافیک NVIDIA Quadro

محصولات گرافیکی حرفهای کوادرو (Quadro)، کارایی و قابلیت های حرفهای زیادی در زمینه مهندسی، پزشکی، معماری و رسانهای و … فراهم میآورد. این محصولات بر پایه قدرت پردازش سریع و معماری کپلر (Kepler) ساخته شدهاند.

کارتهای گرافیکی سری Quadro به دو مجموعه کاملاً مجزا تقسیم میشوند. مجموعه اول کارتهای سری Quadro FX هستند که شامل پردازندههای گرافیکی با کارایی بالا برای اجرای نرمافزارهای طراحی صنعتی هستند و دسته دوم کارتهای سری Quadro NVS هستند که در زمینه CAD/CAM و سیستمهایی که به چندین خروجی نمایشگر به هم پیوسته نیاز دارند طراحی شدهاند. نامگذاری مدلهای مختلف سری Quadro نسبت به کارتهای گرافیکی مخصوص سیستمهای خانگی، متفاوت است. این دسته از محصولات بیشتر در Workstation ها استفاده میشوند.

2- کارت گرافیک NVIDIA Geforce

این دسته کارت گرافیک بر اساس معماری کپلر طراحی شدهاند و از GPGPU پشتیبانی میکنند که باعث بالا بودن کارایی در آنها میشود. اولین دسته از محصولات جی فورس در سال 1999 عرضه شد و جدیدترین کارت گرافیک های Geforce در قالب سری 20 و سری 16 به ترتیب در سال 2018 و 2019 وارد بازار شد. تا به حال 16 سری مختلف از جی فورس ها به مشتریان ارایه شده است.

3- کارت گرافیک NVIDIA Tesla

کارت گرافیک های Tesla در زمینه دیتاسنتر حرف اول را میزنند زیرا توان عملیاتی، کارایی و Uptime را به حداکثر میرسانند. NVIDIA آن را برای مصارف پیشرفته و انترپرایزی ارایه داده و از جمله کاربردهای آن در محاسبات سنگین گرافیکی، انیمیشن و رندرینگ، تحقیقات آنالیز علمی، پیادهسازی VDI، سرورها و سیستمهای HPC و بیگ دیتا، به بازار معرفی کرده است. NVIDIA Tesla K40 و NVIDIA Tesla K80 از جمله مدلهای این دسته کارت گرافیک های انویدیا است.

نقاط قوت کارت گرافیک انویدیا جی فورس (NVIDIA GeForce GPU)

سرعت کلاک (clock Speed) سریعتر: کارت گرافیک های Geforce معمولا 10 تا 20 درصد، GPU Clock Speed سریعتری دارند. مثلا سرعت کلاک در Geforce GTX 1070 برابر با 1683 مگاهرتز است در حالی که در Quadro P2000 که کمی گرانتر هم هست، 1470 مگاهرتز است. چنین سرعتی، کارایی کلی سیستم را بهتر میکند.

تنوع و ارزشمندی: سرعت کلاک بیشتر در کنارِ داشتن هستههای cuda و vram بیشتر که کار پردازش را سریعتر میکنند، باعث میشود Geforce ها برای اغلب سیستمها مناسب باشند. با بودجه متوسط میتوانید Geforce بسیار خوبی بخرید.

پشتیبانی از چند مانیتور و صفحه نمایش: گیمرها و کسانی که Multi Tasking انجام میدهند، اغلب از 3 یا 4 یا حتی 8 مانیتور استفاده میکنند. کارت گرافیک های Geforce بهترین راهکار را دارند. کارت گرافیک های سری 20، از مدل RTX 2060 به بعد از 4 مانیتور پشتیبانی میکنند و با استفاده از کارت گرافیک دوم، این تعداد، دو برابر میشود. بسیاری کارت گرافیک های Quadro (البته بدون در نظر گرفتن سری nvs و سریهای بسیار پیشرفته)، حداکثر دو صفحه نمایش را پشتیبانی میکنند و برای تعداد بیشتر باید آداپتور و اسپیلیتر استفاده کرد.

GeForce برای چه کسانی بهترین کارت گرافیک است؟ گیمینگ و بازی، CAD معمولی، جاهایی که نیاز به چندین مانیتور داریم و ادیت ویدئو در حد معمولی.

نقاط قوت کارت گرافیک انویدیا کوآدرو (NVIDIA Quadro GPU)

کارهای خاص رندر کردن: کارت گرافیک های Quadro برای کارهای خیلی خاصی در رندرینگ، طراحی شدهاند مانند طراحی CAD و رندرینگ حرفهای ویدئو. واضح است که در این موارد Quadro بهترین انتخاب است و با فاصله بسیار با GeForce قرار میگیرد.

قدرت بسیار بالا: کارت گرافیک های Geforce، گزینههای قدرتمندی مثل RTX 2080 Ti را دارد اما برای داشتن حداکثر کارایی، رقیبی برای Quadro وجود ندارد. مثلا Quadro P6000 دارای 24 گیگابایت GDDR5X VRAM و هستههای3840 CUDA است در نتیجه قدرت 12 TFlops را فراهم میکند و Quadro حتی نزدیک آن هم نمیرسد. البته که این قدرت، بودجه بیشتری هم میطلبد اما اگر در بودجه محدودیتی ندارید، Quadro GPU سلطان این عرصه است.

کارت گرافیک های Quadro را میتوان به کارت گرافیک های انویدیا تسلا (NVIDIA Tesla) وصل کرد که در این صورت رندرینگ و مجازی سازی، همزمان پشتیبانی میشود و همچنین کارایی بسیار بسیار بالایی خواهیم داشت. NVIDIA Tesla سیستمی است که به عنوان NVIDIA Maximus هم مینامند.

پردازشهای بسیار دقیق و حساس: برای پردازشهای بسیار دقیق و پیچیده مانند محاسبات علمی و ریاضی، کارت گرافیک های Quadro مناسب هستند. کوآدرو نسبت به همتای Geforce آن، کارایی بالاتری دارد. این مورد، مورد خاصی است اما اگر با آن سروکار داشته باشید، اهمیت آن را میدانید.

طول عمر: کارت گرافیک های Quadro مشابه پردازندههای زئون، با هدف طول عمر و دوام بالا طراحی شدهاند.

کوآدرو، برای چه کسانی بهترین کارت گرافیک است؟ محاسبات دیتا و علمی، بورس، CAD Rendering، تولید حرفهای ویدئو، تولیدات سه بعدی.

مقایسه انواع کارت گرافیک های NVIDIA Quadro و NVIDIA GeForce

پردازش موازی از مهمترین ویژگیهای کارت گرافیک های انویدیا کوآدرو است که سرعت و کارایی بالایی برای مدل سازی و انیمیشن و طراحی صنعتی فراهم میکند اما از طرفی باعث میشود کارت گرافیک quadro برای بازی و گیمینگ، کمتر مناسب باشد و حتی در برابر کارت گرافیک های معمولی که در پردازش پیکسل توانا هستند، کارایی کمتری در این زمینه دارند چون بخش اعظمی از فعالیت آنها مربوط به پردازشهای سنگین است. با این توضیحات Geforce GPU برای گیمینگ مناسبتر است. مثلا کارت گرافیک Quadro FX 1800 بسیار نزدیک به Geforce GT 9600 است اما هر یک کاربردهای مختلفی دارند یکی برای کار با نرم افزارهای حرفهای و دیگری برای بازی.

کارت گرافیک هایی که برای مصارف حرفهای کاربرد دارند، قیمت بالاتری هم نسبت به کارت گرافیک های معمولی دارند. اما قیمت بالاتر و مخاطب حرفهای و خاص آنها باعث نشده این محصولات، تنوع کمی داشته باشند.

کدام کارت گرافیک؟ NVIDIA Quadro یا NVIDIA GeForce؟

حالا رسیدیم به این که واقعا کدام کارت گرافیک برای PC و Workstation و یا سرور شما مناسب است و کدام را باید انتخاب کنید. ابتدا باید کاربرد مورد نظرتان را از کارت گرافیک مشخص کنید و در مرحله بعد بودجه مطرح میشود. برای بودجههای کم تا متوسط، همواره کارت گرافیک NVIDIA GeForce پیشنهاد میشود چون ارزشمندی خرید و تنوع دارد و برای گیمینگ و مصارف عمومی مناسب هستند اما اگر به صورت حرفهای با CAD و ویدئو کار میکنید و کارایی بسیار بالا در رندرینگ لازم دارید، کارت گرافیک NVIDIA Quadro برای شما مناسب است که دارای دو سری FX و NVS است. البته نوع نرم افزار مورد استفاده شما هم میتواند تعیین کننده نوع کارت گرافیک مورد نیاز شما باشد. برخی نرم افزارها با جی فورس و برخی با کوآدرو سازگارند. بعد از بررسی تفاوت کارت گرافیک quadro با Geforce gtx، برویم به سراغ برترین کارت گرافیکهای سال 2019 و 2020.

رده بندی بهترین کارت گرافیک nvidia در سال 2019 (دسکتاپی و عمومی)

ترتیب کارت گرافیک های nvidia از نظر کاربران در بازار به شرح زیر است:

- Nvidia GeForce RTX 2080 Ti

- Nvidia GeForce RTX 2080 super

- Nvidia GeForce RTX 2070 Super

- Nvidia Geforce RTX 2060 Super

- Nvidia GeForce GTX 1660 Ti 6G

- Nvidia GeForce GTX 1660 6G

- Nvidia Quadro RTX 6000

- Nvidia GeForce GTX 1060 6GB

رده بندی بهترین کارت گرافیک nvidia برای بازی در سال 2020

GeForce RTX 3080: از نظز سرعت در مکان دوم قرار دارد و قیمت معقولتری نسبت به 3090 و 2080 Ti دارد. پشتیبانی از 4K، برق 320 وات، کلاک پایه 1710 مگاهرتز و رم 10GB GDDR6X 19 Gbps و تعداد هستههای 8704 از ویژگیهای آن است.

GeForce RTX 3090: سریعترین کارت گرافیک است و دو برابر قیمت نسبت به 3080 و 10 تا 15 درصد کارایی بیشتر دارد. پشتیبانی از بازیهای 4K و حتی 8K، برق 350 وات، کلاک پایه 1695 مگاهرتز و رم 24GB GDDR6X 19.5 Gbps و تعداد هستههای 10496 از ویژگیهای آن است.

GeForce RTX 3070: بهترین کارت گرافیک با قیمت حدود 500 دلار است. با نصف قیمت نسبت به 2080 Ti کارایی نزدیک به آن را دارد. پشتیبانی از تورینگ و DLSS، برق 220 وات، کلاک پایه 1730 مگاهرتز و رم 8GB GDDR6X 14 Gbps و تعداد هستههای 5888 از ویژگیهای آن است.

GeForce RTX 2060: کمترین قیمت را با وجود تکنولوژی تورینگ و DLSS دارد. پشتیبانی از تورینگ و DLSS و سرعت بالا، برق 160 وات، کلاک پایه 1680 مگاهرتز و رم 6GB GDDR6X 14 Gbps و تعداد هستههای 1920 از ویژگیهای آن بوده و از GTX 1070 Ti بهتر است.

GeForce GTX 1660 Super: این کارت گرافیک 15 درصد از 1660 معمولی و 20 درصد از RX 5500 XT 8GB سریعتر است. پشتیبانی از برق 125 وات، کلاک پایه 1785 مگاهرتز و رم 6GB GDDR6X 14 Gbps و تعداد هستههای 1408 از ویژگیهای آن است.

GeForce GTX 1650 Super: این کارت گرافیک 15 درصد از 1660 معمولی و 20 درصد از RX 5500 XT 8GB سریعتر است. با بودجه کم، هر نوع بازی را میتوانید اجرا کنید. پشتیبانی از برق 100 وات، کلاک پایه 1725 مگاهرتز و رم 4GB GDDR6X 12 Gbps و تعداد هستههای 1280 از ویژگیهای آن است.

تفاوت کارت گرافیک gtx با rtx

چند وقتی است که با ورود کارتهای گرافیک RTX تحول چشمگیری در بازار به وجود آمده است. بیایید کارت گرافیک های سری GTX و RTX انویدیا را با هم مقایسه کنیم.

RTX برگرفته از هستههای به کار رفته در معماری این نوع کارت گرافیک است: هستههای Ray Tracing و Tensor. عبارت Ray Tracing به معنی رهگیری پرتو است که ردپایش را در نامگذاری کارت گرافیکهای RTX میبینیم. RT هستههای پردازشی جدیدی هستند که به همراه هستههای تنسور – Tensor در کنار هستههای کودا جای خود را بین کارت گرافیکهای GTX بازکردهاند. هستههای RT رفتار نور را در برخورد به اجسام شبیه سازی میکند و تکنیک سایهزنی یا Shading را پیاده سازی میکنند. هستههای Tensor برای DLSS یا Deep Learning Super Sampling به کار میروند تا یادگیری ماشین را با کارت گرافیک همراه کنند. DLSS اساسا هوش مصنوعی را در بازیها به کار میبرد تا زوایا را طبیعیتر کند.

شاید هنوز تمام بازیها نتوانند از این تکنولوژیها استفاده کنند اما با همراهی بازیسازان روز به روز به تعداد بازیهای قابل پشتیبانی در RT و DLSS اضافه میشود. بازیهایی مثل Battlefield V و Control و Metro Exodus و Shadow of the Tomb Raider با RT و DLSS سازگارند.

در سال 2019 انویدیا کارت گرافیک های سری GTX 10 با معماری پاسکال و سری GTX 16 با معماری تورینگ – Turing را عرضه کرد. مدلهای GeForce RTX 2080 Ti و GeForce RTX 2080 از جمله این نوع GPU ها هستند.

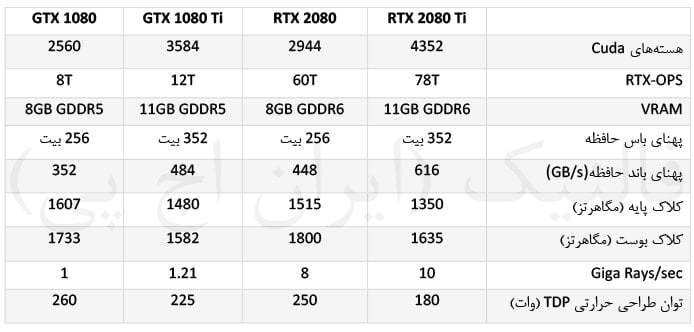

آنچه مسلم است این است که قیمت RTX ها بیشتر از GTX هاست. 4 کارت گرافیک برتر هم از آن این معماری انویدیا هستند. در ادامه به مقایسه کارت گرافیک های GTX 1080 با معماری پاسکال و کارت گرافیک های RTX 2080 با معماری تورینگ میپردازیم.

هم RTX 2080 هم GTX 1080 Ti بسیار سریع هستند و تفاوت آنها به غیر از معماری، رمهای GDDR6 و رزولوشن بالاتری است که RTX 2080 دارد و باعث میشود مچ GTX 1080 Ti را در بازیهای 4K بخواباند. وگرنه هم در ردهبندی و بنچمارک و هم در کارایی تفاوت چندانی ندارند.

HDR برای بیشتر گیمرها فاکتور مهمی نیست اما اگر قصد بازی 4K با HDR دارید، RTX 2080 عملکرد بهتری نسبت به GTX 1080 Ti دارد مخصوصا که با مانیتورهای 4K HDR که قیمت بسیار بالایی دارند استفاده شود.

آنچه درباره کارت گرافیک های NVIDIA آموختیم

در این مقاله با تاریخچه ، انواع و کاربرد کارت گرافیک های NVIDIA آشنا شدیم و چند سری از برترین مدلها را به شما معرفی کردیم. در شرکت فالنیک علاوه بر فروش انواع کامپیوتر و لپ تاپ، تعمیرات دستگاهها هم با بهترین کیفیت انجام میشود. پس در صورتی که کارت گرافیک های NVIDIA شما ایراد دارد برای تعمیر کارت گرافیک یا دریافت مشاورههای رایگان هم میتوانید از کارشناسان فالنیک کمک بگیرید. کافیست با شماره 0218363 تماس بگیرید.

سلام

لپ تاپ استوک hp zbook 15 g5 studioرو میخوام تهیه کنم که پردازنده xenon 2186 داره،کارت گرافیک 4g quadro p1000 داره،بنظرتون از پس بازی های جدید بر میاد؟ممنون

درود بر شما

لپتاپ HP ZBook 15 G5 با پردازنده Xeon 2186 و کارت گرافیک Quadro P1000 مناسب کارهای حرفهای مثل طراحی و رندر است ولی برای بازیهای جدید زیاد قدرتمند نیست

کارت گرافیک Quadro برای بازی بهینه نشده و عملکرد متوسطی دارد

برای بازیهای جدید باید کارت گرافیک قویتر مثل سری GTX یا RTX داشته باشید

اگر بازیهای سنگین میخواهید اجرا کنید، این لپتاپ گزینه ایدهآل نیست ولی برای بازیهای سبک و متوسط جوابگو است

سلام

تو قسمت disply adapters

کارت گرافیک زده gt force gt630

این الان مخصوص خود کامپیوتره یا میشه به ورژن های بالا هم اپدیت کرد

درود بر شما

محمد عزیز،

کارت گرافیک GT Force GT630 یک مدل قدیمی است و مخصوص کامپیوترهای دسکتاپ است. این کارت گرافیک به راحتی قابل ارتقا به ورژنهای بالاتر مثل GTX یا RTX است، اما بستگی به مادربورد و منبع تغذیه سیستم شما دارد.

سلام میخواستم بدونم که کارت گرافیک Nvidia Quadro rtx5000 16g برای گیم مناسبه یا نه مثلا رد دد۲؟؟

مشخصات سیستم : (12 core)core i7 9850

رم ۳۲ ddr4

کارت گرافیکم که Nvidia rtx5000 16g

درود بر شما

محمد عزیز،

کارت گرافیک Nvidia Quadro RTX 5000 16GB عمدتا برای کارهای حرفهای مانند مدلینگ 3D، رندرینگ، CAD، و تحلیل دادهها طراحی شده است، نه برای بازی. هرچند این کارت گرافیک قدرت بالایی دارد، اما برای بازیهایی مانند Red Dead Redemption 2 کارت گرافیکهای GeForce مثل RTX 2080 یا RTX 3070 عملکرد بهینهتری دارند.

سلام میخواستم بدونم که کارت گرافیک Nvidia Quadro rtx5000 16g برای گیم مناسبه یا نه مثلا رد دد۲؟؟

درود بر شما

محمد عزیز،

کارت گرافیک Nvidia Quadro RTX 5000 16GB بیشتر برای کارهای حرفهای مانند طراحی سهبعدی، رندرینگ، و تحلیلهای مهندسی طراحی شده است و برای بازیها بهینه نشده است. در حالی که این کارت گرافیک توانایی اجرای بازیهایی مانند Red Dead Redemption 2 را دارد، کارتهای گرافیک سری GeForce مثل RTX 3070 یا RTX 3080 برای بازیها بهتر عمل میکنند.

سلام من تازه لپ تاپ گرفتم و مشخصات اش هم این هست :

لپ تاپ اچ پی 15 _ fd0xxx

پردازنده : اینتل core i5 نسل 13

رم : 8 گیگ

گرافیک : انویدیا mx550

فضای گرافیک : 2 گیگ

ویندوز 11 _64 بیتی

تصویری که میتونه اجرا بکنه هم تا فول اچ دی هست.

میخواستم بدونم این لپ تاپ برای بازی سازی مناسب هست یا خیر؟

همینطور قدرت اجرای بازی هایی مثل رد دد ریدمپشن ٢ رو داره یا خیر؟

درود بر شما

حسین عزیز، بابت سوال اول بسته به برنامه های نصبی روی دستگاه، اجرای همزمان برنامه و … پاسخ سوال متفاوت خواهد بود. برای اجرای بازی نیز میتوانید بازی را نصب کنید و در صورتی که مشکل داشت گرافیک های اجرای داخل بازی را تغییر دهید اما در زمان نصب نیز میتوانید سیستم مورد نیاز برای نصب را بررسی کنید اگر با مشخصات ثبتی بازی مطابقت دارد میتوانید آن بازی را روی دستگاه بریزید.

سلام خسته نباشید من ی i7 3770 دارم میخواستم بدونم بهترین گرافیکی کا باهاش مچ میشه چیه و گلوگاه نکنه و از تمام قدرت گرافیک استفاده بشه

درود بر شما

علی عزیز، بهترین کارت گرافیکی که با پردازنده i7 3770 سازگار است، کارت گرافیکی است که از سوکت PCIe 3.0 x16 پشتیبانی میکند و از عملکرد کافی برای بازیهای گرافیکی سنگین برخوردار است. مانند NVIDIA GeForce RTX 3060 و AMD Radeon RX 6600 XT

اگه به خوایم بگیم کوادر ک1100, با کدوم جی تی ایکس برابره؟چی میگیم؟ ینی کدوم گرافیک جی تی ایکس با ک 110یکیه از نظر کارایی

یوسف عزیز، کارت گرافیک NVIDIA Quadro K1100 یک کارت گرافیک حرفه ای است که از پردازنده گرافیکی GK107 استفاده میکند و دارای 1280 هسته CUDA است. فرکانس پایه این کارت گرافیک 1050 گیگاهرتز و فرکانس بوست آن 1228 گیگاهرتز است. در نتیجه، میتوان گفت که کارت گرافیک Quadro K1100 از نظر کارایی با کارت گرافیک GeForce RTX 3050 برابری میکند.

ایا با کوادرو میشه بازی کرد؟ مثلا با NVIDIA QUADRO FX 2800M میشه FIFA 19 رو اجرا کرد؟؟

سامان عزیز، بله، با کارتهای گرافیک Quadro میتوان بازی کرد، اما عملکرد آنها در بازیهای کامپیوتری به اندازه کارتهای گرافیک GeForce نیست. کارتهای گرافیک Quadro برای کارهای گرافیکی سنگین مانند رندرینگ سه بعدی، ویرایش ویدیو و معماری طراحی شدهاند و دارای ویژگیهای خاصی هستند که برای این کار ها ضروری هستند. این ویژگیها میتواند باعث کاهش عملکرد کارت گرافیک Quadro در بازیها شود.

اگر قصد دارید با کارت گرافیک Quadro بازی کنید، باید انتظار عملکردی مشابه کارتهای گرافیک GeForce میانرده را داشته باشید. همچنین، باید تنظیمات گرافیکی را در بازیها کاهش دهید تا نرخ فریم مناسبی را دریافت کنید.

سلام من میوام لپ تاپ بگیرم برا نرم افزار های معماری اما با توجه به بودجه ای ک دارم بین دوتا گیر کردم اگه راهنمایی کنید ممنون میشم

Zbook 15 g2

CPU i7 4810mq

Ram 16

Ssd 256

Graphic 4gig

Display 17″

و

i7

ram 8 قابل ارتقا

hard 256ssd

گرافیک ۴ گیگ کوادرو k3100m

size 17

نسل چهار ایسووس zen book یا zbook

کدومش بهتره برام

درود بر شما

الهه عزیز، هر دو لپ تاپ انتخاب مناسبی برای نرم افزار های معماری هستند، اما Zbook 15 g2 گزینه بهتری برای شما خواهد بود. Zbook 15 g2 دارای پردازنده قویتر i7 4810mq است که عملکرد بهتری را در نرمافزار های معماری ارائه میدهد. این لپتاپ همچنین دارای رم 16 گیگابایتی است که برای اجرای نرمافزار های معماری سنگین مانند Revit و AutoCAD ضروری است.

سلام.خسته نباشید

ببخشید میخواستم بدونم کارت گرافیک جی فورس 1060برای بازی های متوسط مثل ردمپیش 2یا کال اف دیوتی خوبه

درود بر شما

رضا عزیز، بله، کارت گرافیک NVIDIA GeForce GTX 1060 برای بازیهای متوسط مانند Red Dead Redemption 2 و Call of Duty: Warzone مناسب است. این کارت گرافیک میتواند نرخ فریم بالایی را در این بازیها با تنظیمات گرافیکی متوسط ارائه دهد.

درود.لپ تاپ با گرافیک gtx1660Ti شش گیگ گذینه خوبه برای کار با برنامه های معماری؟؟؟

نداشتن ری تریسینگ این گرافیک مشکلی ایجاد نمیکند؟؟؟

ممنون میشم یه مشاوره کلی در این مورد بدهید

سلام و درود

اگر رم رو بین 8 تا 16 کنید، بهتره. 6 ضعیفه یه کم.

سلام وقت شما بخیر.آیا لپ تاپ اچ پی مدل ویکتوس۰۰۳۳dxبا رم ۱۶گیگ و ۵۱۲ حافظه و گرافیک ۴ rtx۳۰۵۰گزینه ی خوبی جهت خرید در رنج ۴۰ تا ۴۵میلیون می باشد از نظر شما؟جهت کار های روزانه و فتوشاپ نیمه حرفه ای

سلام خسته نباشید…خواستم بدونم کارت گرافیک quadro k1000m 2g میتونه کار منو تو زمینه رندر نسبتا سنگینه محاسبات و مهندسی راه بندازه؟

درود بر شما

مرتضی عزیز، کارت گرافیک Quadro K1000M یک کارت گرافیک حرفهای است که برای کارهای گرافیکی سنگین مانند رندرینگ سه بعدی، ویرایش ویدیو و معماری مناسب است. این کارت گرافیک از پردازنده گرافیکی GK107 استفاده میکند و دارای 192 هسته CUDA است. فرکانس پایه این کارت گرافیک 1050 گیگاهرتز و فرکانس بوست آن 1228 گیگاهرتز است. کارت گرافیک Quadro K1000M میتواند برای رندرینگ نسبتا سنگینه محاسبات و مهندسی مناسب باشد. این کارت گرافیک میتواند مدلهای سه بعدی پیچیده را با سرعت مناسبی رندر کند.

سلام من ي لپ تاپ خريدم كرافيكش جي فورس ٥٢٠mx هستش وقتي ميرم داخل بازي لپ تاپ خيلي داغ ميكنه ولي از بازي ميام بيرون دماي دستگاه كم ميشه وقتي داغ ميشه قسمت سمت چپ كيبورد ك دكمه هاي wو sهستن خيلي داغه جوري ك حرارت رو حس ميكني لطفا كمك كنيد

سلام و درود

به علت گرافیکی بودن بازی ها دما سیستم بالا میرود ولی اگر بیش از حد بالا رفته و سیستم خاموش شود نیاز به بررسی دارد

باسلام و عرض ادب

بنده میخواستم ببینم گرافیکه ddr5 روی مادربرد foxconn ddr2 اجرا میشه؟ رمم ۶ گیگه . سی پیو ۲ هسته ای ۲ گیگ

سپاس

سلام و درود

حسین عزیز

اجرا می شود ولی توصیه نمی شود.

سلام

خانم فهیمی quadro m1000m با چی برابری میکنه؟

واینکه ایا این مدل cpu ها دماشون بالا می ایسته؟ یا برا من مشکل داره؟

درود بر شما

متین عزیز، کارت گرافیک Quadro M1000M از نظر کارایی با کارت گرافیک NVIDIA GeForce RTX 3050 برابری میکند. اگر نگران گرم شدن کارت گرافیک خود هستید، میتوانید از نرمافزار های مدیریت دما مانند MSI Afterburner استفاده کنید. این نرمافزار ها به شما کمک میکنند تا دمای کارت گرافیک خود را کنترل کنید و در صورت لزوم، تنظیمات آن را تغییر دهید.

با سلام . من لب تاب که خریدم . روی لب تابم این نرم افزار nvidia هست و میخواستم بدونم چجوری فعالش کنم . اگه میشه راهنمایی کامل کنین

سلام و درود

درایورش نصبه؟

سلام ببخشید این گرافیک برای گیم مناسبه؟NVIDIA GeForce GT 750M

با سلام و عرض ادب خدمت دوستان و همکاران گرامی

خواستم در مورد : پردازنده های گرافیک ( جی پی یو ) بیشتر گسترش بدهیم که البته من

این مورد را خیلی ها قبول ندارند که میگویند چون یک کارت گرافیک دارای چند برابر یک ورک استیشن

منظور کوادرو ها هست فکر میکنند که باز هم این نکته قابل توجه ( اصلاح خطای حافظه ) را مورد نظر قرار میدهند و میگویند چه کاریه کارت مثلا GTX 2080Ti هم دارای 4320 تعداد کوداکور هست

این سری کوداکورها البته ولی از نظر تکنولوژی فرآیند لیتیوگرافی ساختار این نوع جی پی یو ها ( جی تی ایکس ) مقایسه با (کوادرو مثالP5000) برای فرآیند رندرینگ کار طولانی مدت آن هم با فشار سنگینی که تعداد فریم های یک انیمیشن 4 ساعت با رزولیشن های مثل 4K فکر میکنم ( جی تی ای ایکس ) به دمای 90 درجه برسه و احتمال سوختن ولی کوادرو به رندرینگ خودش ادامه میده با دمای زیر 60 درجه

در کل اصلا نمیشه اون کوداکور ها رو با هم یکسان دانست

درود بر شما

مانی عزیز، از نظر شما ممنونیم. بازخوردهای شما ما را در تولید محتوای با کیفیت تر کمک می کند.

سلام ممنون بابت مطالب خوبتون. من گرافیک لب تاپم جی فورس ۴۱۰ ام هست این چه فرقی میکنه ؟ اخه هر بازی بخوام بگیرم بر حسب rtx و اینجور چیزا نوشته یعنی ۴۱۰ ام میشه چی ؟ بعد من میتون با ۴۱۰ ام فارکرای سه رو بیارم رمم و بقیه چیزا میخوره ولی من نمی دونم ۴۱۰ ام یعنی چی میشه راهنمایی کنید

ممنون

درود بر شما

محمد عزیز، کارت گرافیک GTX 460M میتواند بازیهای گرافیکی متوسط را با نرخ فریم بالایی اجرا کند. برای مثال، این کارت گرافیک میتواند بازی Far Cry 3 را با تنظیمات گرافیکی High، نرخ فریم 30 را در رزولوشن 1080p ارائه دهد. با این حال، کارت گرافیک GTX 460M برای بازیهای گرافیکی سنگین جدید مناسب نیست.

در مورد RTX، RTX یک فناوری جدید است که توسط NVIDIA برای بهبود عملکرد گرافیک در بازیها و نرمافزار های گرافیکی معرفی شده است. این فناوری از ردیابی پرتو استفاده میکند تا گرافیک واقع گرایانهتری را ارائه دهد.

کارت گرافیک GTX 460M از RTX پشتیبانی نمیکند. بنابراین، اگر می خواهید از RTX استفاده کنید، باید کارت گرافیک جدیدتری با پشتیبانی از RTX خریداری کنید.

در نهایت، اگر میخواهید بازی Far Cry 3 را با کارت گرافیک GTX 460M اجرا کنید، میتوانید این کار را انجام دهید. با این حال، باید تنظیمات گرافیکی را کاهش دهید تا نرخ فریم مناسبی را دریافت کنید.

سلام

من میحواهیم که در

Adobe after effect 2020

Adobe premiere pro 2020

وا blender وا 3d max کار بوکنیم من باید کودام نوعه ګرافیک کارډ را خریداري کنیم geforce یا Quadro یا tasla یا نوعې ديګر؟

این مشاخصات کمپیوتر من این است

Dell precision T1700 tower

3.2Ghz ci5

8gb ram

500 gb hdd

dvd RW

19 inch screen

4th genertion

لوطفاًن به سولات من جواب کن

مضرعت میحواهم فرسی را خوب باد نه دارم

سلام و وقت بخیر

رشید عزیز

Quadro و tasla امکان محاسبات gpu دارند.

عالي بود ..مرسي

درود بر شما

از لطف شما ممنونیم.

ایا کارت گرافیکی هم وجود دارد که قابلیت کپچر کردن هم داشته باشد ؟

هست ولی پیشنهاد نمی شود.

با سلام

من یه کارت گرافیک خوب برای کار هایی مثل برنامه نویسی و ادیتینگ و فتوشاپ میخوام

آیا کارت گرافیک geforce gtx 1650 ti برای من مناسب هست؟

و اینکه در مشخصات بعضی از کارت گرافیک ها عبارت ti هم ذکر شده. میخواستم بدونم این عبارت یعنی چی؟

ممنون میشم اگه راهنمایی کنید و با تشکر از سایت خوبتون

سلام و درود

تشکر از بازخوردتان

بله کارت گرافیگ مناسبی است.

کلمه TI مخفف شده کلمه Titanium است و دلیل انتخاب این نام این است که تیتانیوم فلز خاصی است که به دلیل قدرت نسبت به وزنش در صنعت هوا و فضا از آن استفاده می شود.

سلام من یک کارت گرافیکی برای نرم افزار LPS فتوگرامتری میخواهم که برای دید استریو مناسب باشه قبلا کارت گرافیک NVIDIA Quadro FX 3500 جوابگو بود میخواستم بدونم معادل این کارت گرافیکی تو بازار چه کارت گرافیکی موجوده؟ ممنون

سلام و درود

پیشنهاد میکنم با کارشناسان فروش فالنیک تماس بگیرید تا شما را کامل راهنمایی کنند: 0218363 داخلی 5540.

سلام من بین دو کارن گرافیک موندم کودمش بهتره برای فوتشاب می خواستم بین NVIDA GEFORCE620MوNVIDAGEFORCEGTX1660

NVIDA GEFORCE1660

ایا می توان 620 را به 1660 تبدیل کرد

منظور شما از تبدیل چیست؟

با سلام و عرض ادب،

من کار دیپ لرنینگ انجام میدم و بیشتر کارم با تنسورفلو هست. برای اینکه از سرورهای دانشگاه استفاده نکنم میخوام لپ تاپ بگیرم. سوال من این هست که از بین Quadro M2000m، Quadro M1200M و Quadro M1000M که گویا هر سه کیودا رو پشتیبانی میکنند و در سایت خود انویدیا امتیاز محاسبای یکسانی دارند، برای دیپ لرنینگ و تنسورفلو بهتر هستند.

اگر پیشنهاد بهتری دارید هم لطفا بفرمایید.

برای دریافت مشاوره تلفنی با فروش فالنیک با شماره 0218363 داخلی 5542 تماس بگیرید.

Quadro M2000m

سلام آیا کارت گرافیک geforce gtx 1650 4g برای کار طراحی سه بعدی رندرینگ خوب و قوی هست؟ ممنون

کارت گرافیک geforce gtx 1650 4g کار رندرینگ با زمان طولانی اجرا می کنه بهتر از این مدل، کارت گرافیک GeForce RTX 2060 8GB هست.

بین این دو مدل ۱۵ میلیون اختلافه و نمیشه جایگزین کرد

سلام من برای کارهای بورسیم به کارت گرافیکی نیاز داردم که بتونم همزمان چند مانیتور با تصاویر مجزا داشته باشم ممنون میشم راهنمایی بفرمائید با تشکر

سلام

برای دریافت مشاوره از همکاران فروش در فالنیک با شماره 0218363 داخلی 5540 تماس بگیرید.

مشخصات کارت گرافیک رو سرچ می کنید خروجی مانیتور ها همزمان هم باید چک کنید.

سلام می خواستم بدونم گرافیک quadro k1100m 2GB با چه مدل geforce برابری میکند ؟

از کارت گرافیک مدل quadro k1100m 2GB بیشتر برای مدل های محاسباتی و شبیه سازی و ماینینگ استفاده می شود. کارایی این مدل با جی فورس کاملا متفاوت است و نمی توان معادل سازی انجام داد.

سلام من یک دستگاهی دارم که از کارت QUADRO FX 540 استفاده میکند که متاسفانه خراب شده

آیا کارتی مشابه آن میتوانید معرفی کنید البته جهت استفاده در Win 2000

fh ja;v

سلام وقت بخیر

برای دریافت مشاوره در این زمینه با شماره تلفن واحد فروش فالنیک 0218363 داخلی 5540 تماس بگیرید.

سلام کارت گرافیک من quadro 2000k 3gig هستش ولی بازی هایی که اجرا میکنم یکم لگ میزنه وقتی رزلوشن بازیو میارم پایین درست میشه یعنی مشکل از گرافیکه که برای بازی مناسب نیس؟ در ضمن بازیا خیلی سنگینم اجرا نمیکنم رمم 16 و سی پی یو i7 دارم. هاردمم جامد 5400 دوره. میتونه هم از هارد باشه؟

لطفا با شماره 0218363 داخلی 204 تماس بگیرید تا همکاران ما در بخش فنی شما را راهنمایی کنند.

سلام علیکم

آیا گرافیک کوادرو5000 یا کوادروk2200 برای ساخت موشن گرافیک مناسبه؟ یا جیفرس بگیرم؟

سلام

ساختار کودرو برای کار حرفه ای و طولانی مدت طراحی شده در حالی که ساختار جی فورس برای سیستم های بازی توصیه می شود.

با توجه به حجم کار خود، پیشنهاد می کنیم از یکی از مدلهای کوآدرو موجود در بازار استفاده کنید.

موفق باشید.

سلام.من لپتاپ hp zbook g3 رو خریداری کردم با گرافیک کوادرو m1000m و وقتی یک بازی فوتبال نصب کردم به سرعت داغ کرد و سرعت اجرای بازی هم کاهش یافت .قبلش تحقیق نداشتم که این گرافیک مناسب بازی نیست.سوال من اینه که الان نمیتونم اصلا با این گرافیک بازی کنم یا میشه با انجام کارهایی روی سیستم بازی رو انجام بدم؟

سلام

در این زمینه بهتر است با کارشناسان ما به صورت تلفنی در ارتباط باشید. راهنماییتان می کنند.

0218363 داخلی 230

سلام واسه رندر انمیمیشن کارت ۲۰۸۰ rtx بهتره یا pny rtx 4000? من خیلی گشتم ولی مطمین نشدم هنوز به این خاطر میگم چون از نظر قیمت نزدیک هستند. واسه این مقایسه کردم برای خرید! و اینکه 2080 هسته بیشتری داره و کوادرو مختص رندرینگ ه واسه همین موندم توی انتخاب.

سلام

شما می توانید برای مشاوره و خرید کارت گرافیک، با کارشناسان لپ تاپ و کامپیوتر ما به شماره 0218363 داخلی 230 در تماس باشید.

سلام خسته نباشید

لبتاب بین ۱۰تا ۱۵ میلیون برای بازی چی پیشنهاد میکنید

سلام

در اینت زمینه می توانید با کارشناسان فروش ما در ارتباط باشید. به طور دقیق شما را راهنمایی می کنند.

شماره تماس: ۰۲۱۸۳۶۳ داخلی ۲۳۰

با سلام و تشکر از مطالب شما

لپ تاپی جهت انجام کار ادیت عکس با فتوشاپ مدنظرم هست که خارج از اینکه نمایشگر OlED مد نظرم هست، با انتخاب این دو کارت گرافیکی مواجه هستم :

۱. QUADRO T2000 w/ 4Gb -DDR5

۲.Geforce GTX 1650 / 4G – DDR5

با تشکر

سلام

در اینت زمینه می توانید با کارشناسان فروش ما در ارتباط باشید. به طور دقیق شما را راهنمایی می کنند.

شماره تماس: 0218363 داخلی 230

با سلام برای یک سیستم متوسط که کار رندر و گیمینگ نمی خواد انجام بده چه کارت گرافیکی رو پیشنهاد میدید که ضعیفم نباشه خیلی

ممنون

سلام

شما میتونید برای مشاوره و خرید کارت گرافیک با کارشناسان ما در ارتباط باشید.

شماره تماس: ۰۲۱۸۳۶۳ داخلی ۵۵۴۰

کارت گرافیک 1660tiبرای گیم مناسبه ؟

سلام، بله برای بازی های ساده مناسب است.

سلام توضیحاتی در مورد کارت گرافیک حرفه ای با معمولی بدین واینکه مثلا میگن گرافیک 2حرفه ای از 4یا8معمولی بهتره واقعا همینطوریه؟

ممنون

سلام

آن عددی که با گیگابایت در اسم کارت گرافیک اعلام می شود در قدرت آن اثرگذار نیست

مهم ترین عامل در قدرت گرافیک قلب پردازنده آن است

در اصل گرافیک به آن واحد پردازش گرافیکی می گویند

مهم ترین عوامل در مشخصات فني كه بايد به آن توجه داشت موارد زیر است:

تعداد هسته هاي پردازشي (CUDA Core)

فركانس هر هسته پردازشي

مشخصات شيدر

و پهناي باند حافظه هست

در نهايت كارتهاي حرفه اي و معمولي بيشتر در اين موارد متفاوتند

سلام

خیلی ممنون بابت مطلب بسیار مفیدتون

میخواستم بپرسم بین MX110 و GTX1050 کدوم برای بازی بهتره؟

اگه ممکنه یه مطلب هم در مورد مقایسه کرافیگ های GTX, MX, RTXها در سایت قرار بدید

و گرافیک های دسته گیم رو بیشتر باز کنین.

مثلا 1660 بر چه اساس شماره گذاری شده و در چه رتبه ای قرار میگیره بین گرافیک های گیمینگ

خیلی سوال پرسیدم

ممنون میشم یه مطلب در این موضوعات قرار بدید.

سلام

سری gtx برای کارهای گرافیکی و بازی طراحی شده است و می توانید استفاده کنید.

بازخورد شما را به تیم محتوا انتقال خواهم داد. سپاس از شما

سلام خسته نباشید:

من در حال حاضر یک کارت گرافیک برای گیمینگ به صورت حرفه ای می خوام ولی تا یک سال آینده با برنامه ی Auto Cad و از این قبیل کار میکنم.

میخواستم ببینم یک گرافیک Quadro میتونه بازی هارا با گرافیک Full مانند GeForce اجرا کنه یا خیر.

با تشکر

سلام

سری RTX مخصوص گیمینگ هست و Quadro برای کارهای سنگین تر.

Quadro برای شبیه سازی علمی یا کارهای صنعتی به کار می رود. به عنوان مثال طراحی سه بعدی

اگر برای کامپیوتر دسکتاپ گمینگ مد نظر است، سری RTX 2080 یا RTX 2070 مناسب است.

اگر برای سرور یا ورک استیشن میخواهید، بر اساس نوع راهکاری که قصد دارید پیاده کنید باید مدل انتخاب کنید مثلا P2000 تا p6000 و …

ممنونم فقط عنوان رو تصحیح کنید طول مدت فایل 17 دقیق هست نه 34 دقیقه!

سلام

ممنون از بازخورد شما، مورد اصلاح شذ

ممنون – لطفا راهنمایی میکنید برای کار انیمیشن کدام یک بهتر هست ؟

Nvidia Quadro RTX 4000

و

Nvidia GeForce RTX 2060

سلام

اگر در سطح حرفه ای نیاز دارید، کارت گرافیک Nvidia Quadro RTX 4000 بهتر است.

میشه در مورد گرافیک NVIDIA GeForce GT 750M توضیح بدین ؟که آیا برای گیم مناسبه یا نه

سلام … وقت بخیر .. ممنونم ازمطالب مفیدتون ،اینقد درمورد کارت گرافیک وسی پی یو خوندم که قاطی کردم … آقا من میخام 3الی4تومن هزینه کنم واسه لپ تاپ .. نرم افزار خاصی رو کار نمیکنم ولی یهو میزنه سرم 3dmax یافتوشاپ کارمیکنم .. ازیه طرفم اصلا کارنمیکنم .. میخام یه لپ تاپی بگیرم که نه خیلی کاراییش پایین باشه نه خیلی حرفه ای که نتونم پولشو بدم ..ممنون میشم اگه کسی کمکم کنه در این بازاری که برادر به برادر رحم نمیکنه 😆😆

سلام

در این زمینه نگران نباشید. اگر قصد خرید لپ تاپ دارید، می توانید با کارشناسان فروش ما مشاوره کنید.

شماره تماس: 0218363 داخلی 230

سلام

ممنون از توضیحتون

به نظر شما بین k5100m و gtx1060 کدوم برای کار با نرم افزار های ادوبی و ۳دی بهتره؟

سلام

Quadro K5100M: Mobile workstation, Kepler Architecture, 2013, 771MHZ, 8GB GDDR5, 115 GB/sec, 512KB L2 cache, 100W,

GTX 1060: Performance graphic card, Pascal Architecture, 2016, 1594 MHz, 6GB GDDR5, 192GB/s, 2048 KB L2 cache, 120w, VGA HDMI DVI DIsplay port

سلام. دومی کارت گرافیکی همه منظورست. و از نظر کارایی از همه جهات دومی قوی تر است.